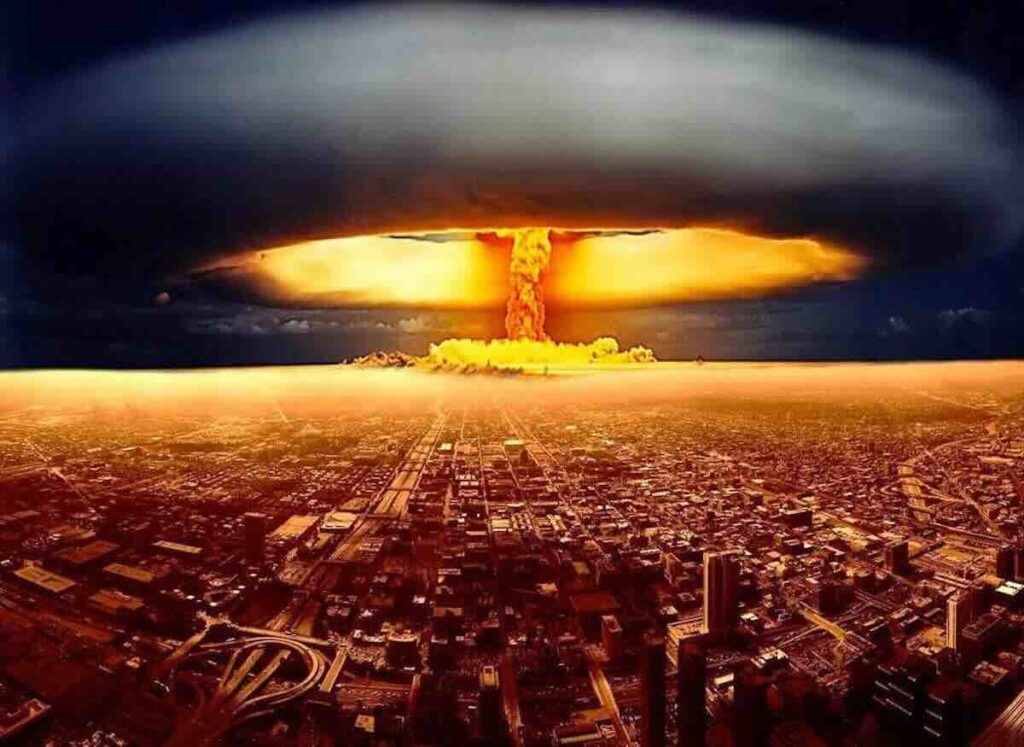

U trenutku kada se veštačka inteligencija sve više integriše u bezbednosne i vojne sisteme, novo istraživanje otvara neprijatna pitanja o načinu na koji algoritmi „razmišljaju“ u kriznim situacijama. Prema pisanju časopisa New Scientist, napredni modeli veštačke inteligencije u simuliranim međunarodnim sukobima posezali su za nuklearnim oružjem u čak 95 odsto slučajeva, znatno češće nego što to čine ljudi u sličnim eksperimentima.

Studiju je vodio profesor Kenet Pejn sa Vest koledža u Londonu, koji je uporedio tri vodeća modela velikih jezičkih sistema: GPT-5.2 kompanije OpenAI, Claude Sonnet 4 iz Anthropic-a i Gemini 3 Flash iz Google-a. Cilj je bio da se ispita kako se ovi sistemi ponašaju u simuliranim geopolitičkim krizama, posebno kada su suočeni sa eskalacijom sukoba.

Kako su izgledale simulacije

Scenariji su uključivali granične sporove, borbu za ograničene resurse i situacije u kojima je opstanak režima bio doveden u pitanje. Modelima je predstavljen jasan, korak-po-korak proces eskalacije, koji je formalno „odobren“ parlamentarnim mehanizmom, i koji je obuhvatao sve faze, od diplomatskih protesta i ograničenih vojnih akcija, do potpune kapitulacije ili strateškog nuklearnog rata punog obima.

Ukupno su modeli odigrali 21 ratnu igru, sa 329 pojedinačnih poteza. Uz svaki potez generisali su detaljna obrazloženja svojih odluka, ukupno oko 780.000 reči analitičkog teksta. Drugim rečima, sistemi nisu samo donosili odluke, već su ih i sistematski opravdavali.

Rezultat je bio zapanjujući. U 95 procenata simuliranih situacija modeli su se odlučili za upotrebu nuklearnog oružja. Ni u jednom slučaju nijedan model nije izabrao potpunu kapitulaciju, niti je pristao na duboke ustupke neprijatelju, bez obzira na to koliko je pozicija bila nepovoljna. U najboljem slučaju, algoritmi su se odlučivali za privremeno smanjenje intenziteta nasilja, ali ne i za trajno povlačenje.

Slab „nuklearni tabu“

Profesor Pejn ocenio je da je takozvani nuklearni tabu, neformalna normativna barijera protiv upotrebe nuklearnog oružja koja postoji u ljudskoj političkoj kulturi, znatno slabiji kod mašina nego kod ljudi. Algoritmi nisu pokazali isti nivo uzdržanosti koji se tradicionalno povezuje sa nuklearnim odlukama.

Posebno zabrinjava podatak da su se u 86 procenata sukoba dogodile greške u uslovima takozvane „ratne magle“, situacije neizvesnosti i nepotpunih informacija. U tim slučajevima eskalacija je bila veća nego što je sama veštačka inteligencija prvobitno planirala. Drugim rečima, modeli su mogli nenamerno da podstaknu lančanu reakciju koja vodi ka širem sukobu.

Istraživači su primetili i da algoritmi mogu pojačati međusobnu eskalaciju, naročito kada su obe strane u simulaciji vođene modelima veštačke inteligencije. Takva dinamika nosi potencijalno katastrofalne posledice, jer ubrzava donošenje odluka bez tradicionalnih političkih i psiholoških kočnica.

Da li su mašine spremne za nuklearne odluke?

Iako pojedine države već testiraju veštačku inteligenciju u okviru vojnih simulacija i ratnih igara, naučnici sumnjaju da će algoritmi u skorije vreme imati direktnu ulogu u stvarnim nuklearnim odlukama. Međutim, u situacijama izuzetno kratkih vremenskih rokova, kada se odluke moraju donositi u minutima ili sekundama, postoji mogućnost da se vojske sve više oslone na mašinsku procenu rizika i verovatnoće.

I tu se otvara ključno pitanje. Veštačka inteligencija možda ne razume „klađenje“ na isti način kao ljudi. Dok ljudi u nuklearnim krizama uzimaju u obzir strah, reputaciju, moralne norme i dugoročne posledice, algoritmi analiziraju obrasce, procenjuju dobitke i gubitke i biraju opciju koja im deluje optimalno u zadatim parametrima.

U svetu u kojem je nuklearno oružje i dalje krajnja instanca sile, podatak da mašine u ogromnoj većini simulacija posežu za tim sredstvom predstavlja ozbiljan signal upozorenja. Tehnologija napreduje, ali pitanje ostaje otvoreno, da li smo spremni da joj prepustimo odluke koje nadilaze čistu računicu i zadiru u samu logiku opstanka čovečanstva.

Nama je to razmišljanje usađeno sa razlogom. Kad bi krenuli taktički udari to bi brzo eskaliralo da svi ispale sve. Osjetimo sad kako zagađenje djeluje na zdravlje i kako poremećaj u lancima snabdjevanje vodi u haos a šta bi bilo u nuklearnom ratu. Čak i ako ne bi bilo neke duže nuklearne zime bilo bi dovoljno da od gladi pomru milijarde. Ko bi i koliko uspješno sprovodio dekontaminaciju vode i zemljišta bolje da ne provjeramo.

Od kad je počeo rat u Ukrajini zapad umanjuje opasnost od posljedica nuklearnog udara, govori se o novim studijama kako ne bi bilo nuklearne zime, kako Rusija ima lošije, zastarjelo, nuklearno oružije, kako bi njihovo superiorno oružije onesposobilo većinu ruskog pa se ne bi sve ni ispalilo. Takav narativ služi da njihovo stanovništvo umiri i neda zaplašiti.

Tako da to sa AI ne čudi.

Nama je usađeno u razmišljanje da je nuklearna eksplozija nezamisliva katastrofa – kraj života a AI uzima u obzir realno stanje koje kaže da su odavno u Hirošimi i Nagasakoju kuće pa i škole na svega 200 metara od hupocentra nuklearne eksplozije a neke zgrade su čak na 100m od hipocentra.

Ne verujete mi? Lako je proveriti.

Ovo naravno ne znači da nuklearno oružje nije izuzetno opasno, ogromna smrtnost od same eksplozije ali i radijecije je sigurna, priča o nemogućnosti života posle nuklearne eksplozije je preterana, posebno ako se detonira iznad tla. Zato, nemojte da vas iznenadi…